Una corsa agli armamenti dotati d’intelligenza artificiale tra la Cina, la Russia e gli Stati Uniti potrebbe portare a una catastrofe per l’umanità.

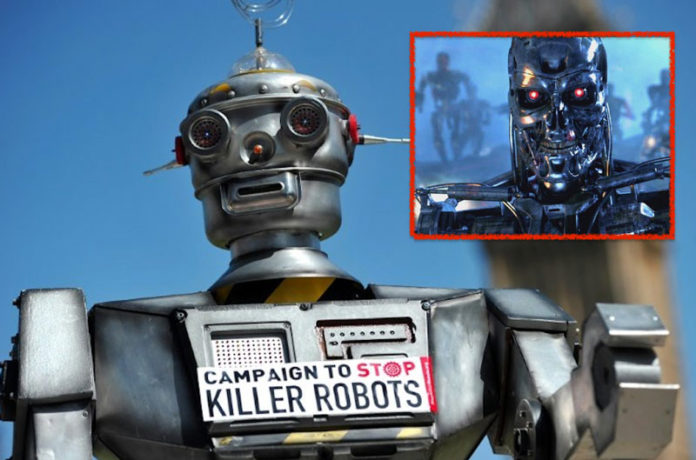

Secondo uno studio dell’organizzazione olandese Pax, il rischio sarebbe tale da chiedere un divieto preventivo dei cosiddetti robot killer e ha avvertito che lo sviluppo della tecnologia potrebbe arrivare a degli algoritmi per decidere se le persone debbano vivere o morire.

«Una corsa agli armamenti con IA … è più probabile che sia una situazione senza alcuna vittoria … sarebbe destabilizzante e aumenterebbe le possibilità di conflitto. Avrebbe impatti economici, politici e sociali negativi», si legge nello studio che ha esaminato la spinta verso l’IA in sette nazioni tra cui Stati Uniti, Cina e Russia, riporta Scmp.

Ha detto che lo sviluppo di armi autonome letali – progettato per ridurre i tempi di reazione e rendere più precisi gli attacchi – stava limitando il processo decisionale sull’uso della forza e aumentando il rischio di perdite di massa. Le maggiori potenze militari mondiali hanno investito pesantemente nell’IA e stanno cercando di sviluppare armi autonome come droni o sottomarini, in grado di rilevare un bersaglio nemico e attaccare automaticamente.

Gli Stati Uniti stanno facendo dell’IA una priorità e l’anno scorso hanno istituito un Joint Artificial Intelligence Centre per supervisionare lo sviluppo della tecnologia da parte dei suoi servizi e delle agenzie di difesa. Nel frattempo, la Cina ha istituito due importanti organizzazioni di ricerca incentrate sull’IA e sui sistemi senza pilota nella sua corsa per tenere il passo con gli Stati Uniti. Pechino sta ricercando un “gioco di algoritmi” che aiuterà a prevedere cosa succede sul campo di battaglia.

Anche la Russia sta dando la priorità all’IA, dice il rapporto, e la sua tabella di marcia per lo sviluppo della tecnologia dovrebbe essere rilasciata nel giro di pochi mesi.

Pax chiede alla comunità internazionale di lavorare su una chiara regola internazionale che gestisca l’uso di armi letali autonome. Attualmente, gli Stati Uniti sono uno dei pochi paesi ad avere una politica specifica sui sistemi d’arma autonomi letali progettati per ridurre il rischio che i robot killer attacchino gli obiettivi sbagliati.

Nel 2012, il Pentagono ha ordinato che «i sistemi d’arma semi-autonomi che sono a bordo o integrati con piattaforme non presidiate devono essere progettati in modo tale che, in caso di comunicazioni degradate o perse, il sistema non selezioni e non coinvolga autonomamente singoli bersagli o gruppi target specifici che non siano stati precedentemente selezionati da un operatore umano autorizzato».

Maddalena Ingrao